张家树教授团队指导的国际留学生在计算机视觉顶刊IJCV发表长篇综述

近日张家树教授导师团队在国际学生培养方面取得重要成果,2026年1月6日,团队所指导的国际博士生RAZAN ALHARITH在International Journal of Computer Vision (IJCV)发表了长达44页的一篇题为《Concept-Based Explanation for Deep Vision Models: A Comprehensive Survey on Techniques, Taxonomy, Applications, and Recent Advances》综述文章。 IJCV是中国计算机学会(CCF)和中国人工智能学会(CAAI)推荐的A类期刊,也是计算机视觉领域最被认可的两大期刊之一。 2022级计算机科学与技术博士生RAZAN ALHARITH为第一作者,张家树教授为通讯作者,论文作者还包括团队青年教师吴振宇副教授,西南交通大学计算机与人工智能学院为第一单位。

人工智能已成为为推动社会进步和经济发展的重要力量,然而,深度学习模型的“黑盒性”常常导致其决策过程难以解释和不可信。因此,提升AI模型透明度,增强用户信任与应用效果的可解释人工智能(XAI)至关重要。

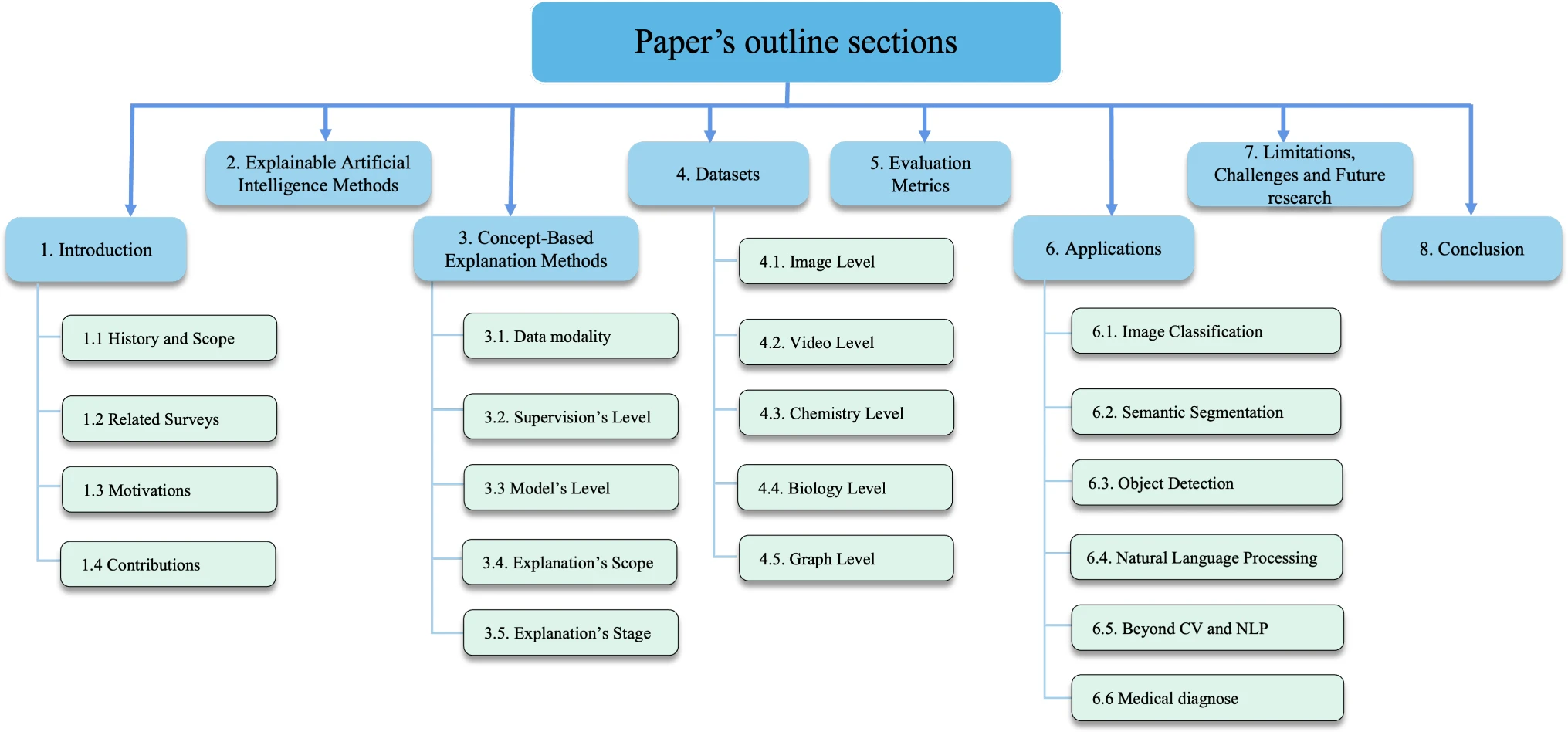

本综述详细总结了人工智能(XAI)的可解释方法,其中,AI模型的概念解释方法(CBX)是利用高级视觉概念代替低级视觉特征,能提供更清晰且更易于理解的模型行为洞察,增强了AI模型推理与人类理解之间的对齐,做出的解释更易理解和有意义。为此,本综述采用一种新的分类法,从数据模态、监督级别、模型级别、解释范围和解释阶段等方面,全面、系统地阐述了面向深度视觉模型的人类更易于理解的概念解释方法(CBX)及其应用研究进展,探讨了当前CBX解释技术的局限性、在深度模型的CBX实现与改进面临挑战,指出了面向深度视觉模型的CBX解释技术未来研究方向。

论文链接:https://doi.org/10.1007/s11263-025-02647-5

相关文章

西班牙哈恩大学副校长一行来访可持续城市交通智能化教育部工程研究中心

2026年3月6日,西班牙哈恩大学副校长何塞·伊格纳西奥·希门尼斯·冈萨雷斯一行到访可持续城市交通智能化教育部工程研究中心,围绕中心建设发展、核心研究方向及团队科研成果开展交流与实地考察。学校国际合作与交流处副处长许军华、学……

学院开展青年教师面对面第三期交流会暨2026年度国家自然科学基金项目申报第五期辅导会

2026年1月22日上午,学院召开了以“汇智青年心声,助力职业发展”为主题的青年教师面对面第三期交流会暨2026年度国家自然科学基金项目申报第五期辅导会。会议特邀国家级人才廖凯教授出席,学院党委书记翟东海及邢焕来、谭言丹、孙……

学院开展青年教师面对面第二期交流会暨2026年度国家自然科学基金项目申报第四期辅导会

2026年1月9日下午,学院召开了以“汇智青年心声,助力职业发展”为主题的青年教师面对面第二期交流会暨2026年度国家自然科学基金项目申报第四期辅导会。会议特邀国家级人才尹高飞教授出席,学院党委书记翟东海及李崇寿、吕风毛、江……